darktable で自動遠近補正する手順(台形補正)

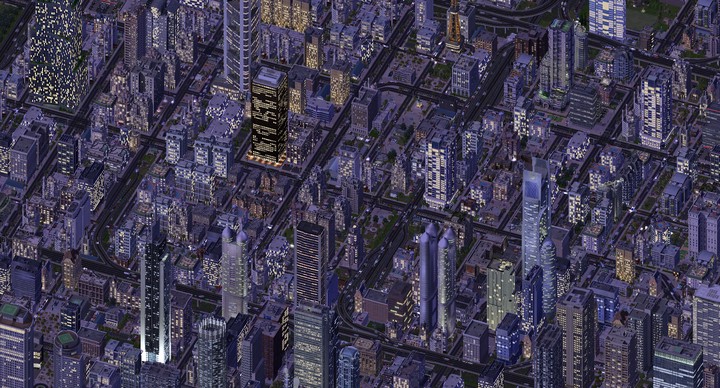

GOG 版 SimCity 4 に旧日本語パッケージ版コンテンツを統合して移行

GOG 版などのデジタルリリースされた SimCity 4 Deluxe では、プログラムの難読化が緩いらしく、コミュニティによる DLL ベースの MOD 開発はこれらデジタル版1のみを対象するように移行していく風潮です。

発売から 20 年経過しても MOD コミュニティが活発であることが喜ばしい一方で、これらデジタルリリース版には日本語コンテンツが収録されていないので、英語テキストでのプレイを強制されます2。

幸い日本語版を所持していれば、デジタル版へのコンテンツの統合が簡単に行えるので、日本語版で DLL 時代を迎える方法をここに記します。ここでは、旧版がインストール済みの環境で GOG 版を追加購入して実行しています。 Steam 版1でも同じようにできると思いますが、GOG 版は DRM が無いので Steam 版よりもおすすめです。 …

sed で個人的によく使うコマンドまとめ

Windows: コマンドラインで優先度を指定しプロセスを起動する方法

Hugo で数式を静的(ビルド時)にレンダリング

このブログでもそうでしたが、Hugo で数式を表示するには、ブラウザで KaTeX か MathJax を使ってレンダリングする構成が一般的でした。

Hugo v0.132.0 から、KaTeX 数式をビルド時に静的にレンダリングする関数 transform.ToMath が追加され、これにより、WASM で動作する KaTeX を使って数式をレンダリングしたものを出力することができ、ブラウザ実行時の JavaScript ライブラリの読み込みが不要になりました。レンダリング結果が最初から入っているので、表示ラグも(ほぼ)発生しません1。 …

fopen したファイルを unlink しても fread できるという話

AMD Ryzen 機で謎のハングアップが発生したら C-State Control を切れ

存在そのものがおそがいエクスプローラーの「元に戻す」機能を無効化する

あの忌まわしいエクスプローラーの「元に戻す」機能を、レジストリを変更するだけで無効化できると知ったのでメモします。

エクスプローラーの「元に戻す」は、コンテキストメニュー上で誤爆しやすい位置にあり、さらに確認ダイアログなしにサイレントに動作するため(こちらは Ctrl + Z 誤爆時に特に致命的)ステルス性能も高く、日頃のファイル整理の努力をわやにするポテンシャルを秘めています。 …

線形回帰モデルの最小二乗解導出

日本語 DeepSeek-R1 Qwen 蒸留 32B のローカル実行を試す

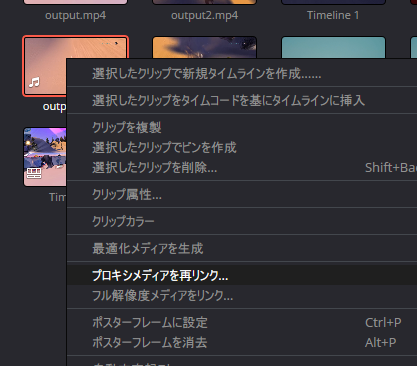

動画編集用に素材を変換する FFmpeg コマンド集

なぜか、年明けから DaVinci Resolve で動画編集の仕事をしています。

DaVinci Resolve で編集中のシークが重かったり、素材の形式に起因する問題等が発生したりしたので、FFmpeg で先に素材を使いやすい形式に変換しておくコマンドをまとめてみました。

この記事での処理内容は、DaVinci Resolve 重視で考えられていますので、ご留意ください。 …